Así influye Facebook en tus opiniones

Las noticias falsas circulan más rápido en cámaras de eco

Hay varios presuntos culpables de la victoria de Donald Trump: la falta de visión de la campaña de Clinton, la globalización, la condescendencia de las elites. Facebook y su modo de seleccionar noticias es otro.

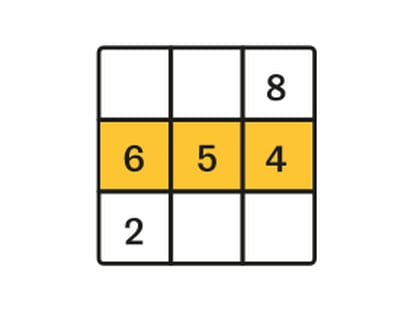

Las cifras de uso de Facebook le dan una capacidad de influencia aplastante. Un 68% de norteamericanos usa Facebook. De ellos, dos tercios lo usan para ver noticias. Si trasladamos ese número a norteamericanos en general, casi la mitad -un 44%- de ciudadanos se informa en Facebook, según datos de Pew.

El ascenso de Facebook ha coincidido con la caída de credibilidad de medios tradicionales. En 2005 el 51% de los americanos tenía mucha o bastante confianza en los medios de comunicación, según Gallup. Desde entonces la confianza ha caído al 32%. El desprestigio es mayor entre los conservadores: sólo un 14% confía en los medios.

Si la percepción desde España es que no hay para tanto, es lógico. La desconfianza de los medios en España es menor: la mayoría de encuestados aún los aprueba según el CIS. Solo un 25% de internautas usó redes sociales para informarse en las elecciones de junio de 2016. Aunque la red preferida también es Facebook: el 74% de los internautas lo usa.

Nuestro círculo es un eco

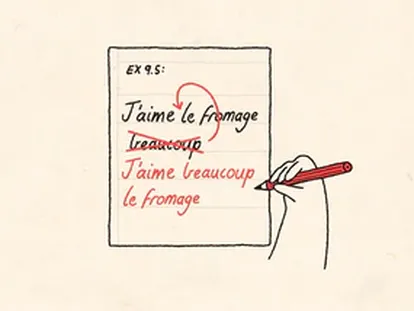

Las fuentes de información que vemos en Facebook las escogemos nosotros. No hay un editor o un periodista que decida el menú informativo. En la pantalla están los medios que elegimos y lo que deciden nuestros amigos. Suelen ser parecidos a nosotros. Es probable que las noticias que compartan nos vayan a interesar.

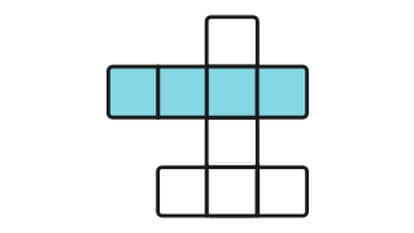

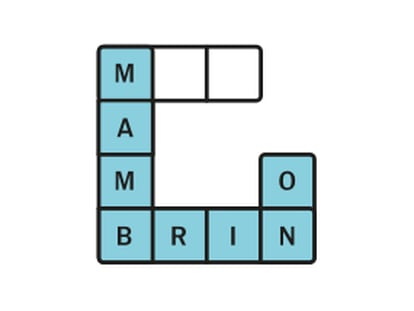

La amplificación de nuestros gustos produce un efecto cámara de eco. Ciertas ideas y creencias se refuerzan cuando se transmiten, repetidas, dentro de un sistema cerrado: nuestro círculo. Las visiones diferentes están censuradas o infrarrepresentadas. “Un ciudadano está en una cámara de eco cuando la mayor parte de la información política que consume confirma sus opiniones previas”, explica Pablo Barberá, profesor de la Universidad de Southern California.

Cada cual construye su cámara de eco.

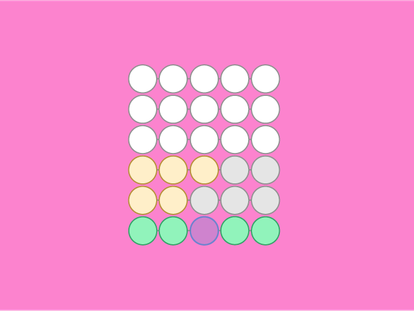

La elección de nuestra red de fuentes reduce la diversidad ideológica a la que nos exponemos. Según un artículo en Science publicado por empleados de Facebook (son los únicos que tienen acceso a ese tipo de datos), los votantes de cierta ideología tienen amigos que comparten noticias de medios afines. Un trabajo de Barberá encontró un efecto similar en Twitter: los intercambios sobre política se producían principalmente entre individuos con preferencias ideológicas similares.

La cámara de eco no existe solo en internet. Los amigos fuera de la red influyen obviamente en las opiniones y elegir un solo periódico de papel reduce la visión del mundo. Las redes sociales como Facebook replican un fenómeno muy humano, casi primitivo: nos gusta lo que confirma nuestros prejuicios.

Las personas tendemos a privilegiar la información que apoya nuestras ideas previas. Esto se conoce como sesgo de confirmación. Las ideas afines nos resultan más convincentes y seguramente más agradables: el 59% de los usuarios reconoce, según Pew, que los desacuerdos sobre política en redes sociales les resultan “frustrantes y estresantes”. Nos disgusta cambiar de opinión.

El algoritmo misterioso

Facebook es una empresa. Su objetivo es lograr que los usuarios estén más rato en su red: a más tiempo más exposición a anuncios. Facebook es de largo la web donde los internautas pasan más minutos. En España los internautas pasan un 18% de su tiempo de navegación desde el ordenador en Facebook, de acuerdo con datos de Netquest.

Si Facebook quiere mantener la atención de sus usuarios, querrá que se sientan cómodos. Aquí aparece el gran misterio de Facebook: su algoritmo. El orden de las noticias que vemos en Facebook lo decide una fórmula que se nutre de nuestras preferencias: “Facebook tiene mucha información que puede usar: qué me gusta, qué leo, quizá dónde me detengo. Si leo mucho de lo que pone un amigo, va a salirme más. Si a otro amigo nunca le leo, no va a aparecerme”, dice Rubén Cuevas, profesor de la Universidad Carlos III.

El algoritmo de Facebook es la puerta de la cámara de eco: destaca lo que cree que nos parecerá más interesante. Este mecanismo tiene un nombre científico: filter bubble (filtro de la burbuja). La burbuja crea un problema mayor que la cámara de eco: la personalización. Así lo explica Jisun An, investigadora del Qatar Computing Research Institute, Hamad Bin Khalifa University: "Ves posts de algunos amigos con los que no estás de acuerdo, así que no le das a “me gusta” y evitas clicar o leer. Esas acciones pueden ser explotadas por el algoritmo de personalización, y con el tiempo puedes dejar de ver ese contenido en tu timeline".

Facebook no revela los detalles de cómo su algoritmo: “Nuestro objetivo es ofrecer el tipo de historias de las que tenemos constancia que más querrá ver una persona concreta”, dijo Adam Mosseri, vicepresidente de dirección de producto de Facebook, en enero. El algoritmo podría por tanto generar más eco. Pero no sabemos si realmente es así. El estudio de Science sugería lo contrario: el algoritmo apenas reducía la diversidad ideológica a la que nos exponemos.

Una definición de posverdad

Las consecuencias de la burbuja para el eco no están bien estudiadas. Los enlaces que comparten nuestros amigos (y conocidos) en Facebook son más diversos: "observamos que las redes sociales incrementaban la diversidad de temas y opiniones en comparación con los medios a los que estaban suscritos sus usuarios", dice Jisun An. Las noticias provienen además de más fuentes y no de un solo periódico.

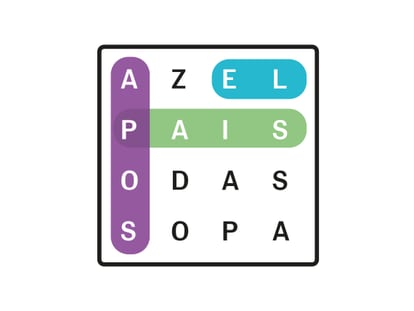

Pero eso no garantiza que sean más plurales. Primero, porque los medios se han multiplicado y sus audiencias son más homogéneas que en la era del papel. Segundo, porque si un lector prefiere un periódico de derechas, en Facebook verá noticias de otras cabeceras que pueden ser igual o más de derechas. Nada garantiza que los titulares que vea ahora no sean radicales, tendenciosos o falsos porque proceden de medios menos fiables.

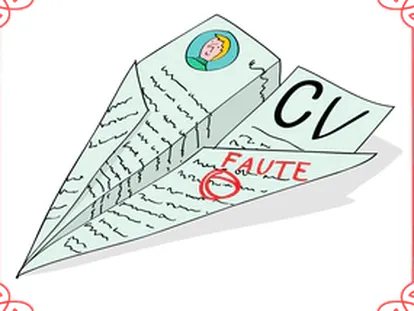

Una gran polémica tras las elecciones en Estados Unidos ha sido el número de noticias falsas que ha circulado. Los usuarios las compartían rápido y las rectificaciones de medios tradicionales apenas tenían recorrido. “El mecanismo es siempre el mismo”, dice Walter Quattrociocchi, profesor en el Instituto de Estudios Avanzados IMT de Lucca (Italia). “Hay muchas narrativas, la gente se suma a la que le gusta más y acaba formando grupos de gente afín donde domina la polarización”, añade. Actúa aquí otro sesgo cognitivo: las creencias colectivas ganan plausibilidad solo al repetirse. Por eso las cámaras de eco refuerzan las ideas preconcebidas: nos las repetimos unos a otros.

El rigor no es en estos casos lo más importante. De hecho, puede ser contraproducente: “Las noticias falsas tienden a propagarse con más velocidad que las verdaderas o son mejor aceptadas en las cámaras de eco”, dice Esteban Moro, profesor de la Universidad Carlos III. Las explicaciones simples nos resultan más convincentes —es otro atajo cognitivo—, independientemente de su veracidad. Es más fácil creer en afirmaciones simples, fáciles de procesar o que se repiten. Más aún cuando confirman nuestros prejuicios. Si el algoritmo quiere gratificarnos va a premiar ese tipo de narrativas.

La combinación de la polarización, el eco y la falsedad puede ser explosiva: “Lo que ha pasado con las redes sociales es que mucha gente pensaba que iban a provocar que la gente saliera de las cámaras de eco. Y vemos que no. Que pueden ser incluso más fuertes que antes”, dice Moro. La cámara de eco de rumores ante solía quedarse en el bar. Ahora circula por la red y parece más fiable.

Hay muchos más medios pequeños produciendo noticias que compartir. Exageradas, pegajosas. Algunas falsas. La verdad tiene menos valor que nuestra narrativa preferida. Es una definición ejemplar de posverdad.

Unas consecuencias desconocidas

Nadie sabe con certeza cuáles son las consecuencias de las burbujas para las opiniones de los ciudadanos. Es improbable que sean responsables únicas de nada. Pero el debate ante lo desconocido es razonable: “Todos estos algoritmos tienen unas consecuencias sociales, lo que no sabemos es cuáles, y están sucediendo ya”, dice Rubén Cuevas.

Las consecuencias del eco no solo influyen en elecciones. Pueden crear corrientes sobre un famoso que cae mal, sobre el cambio climático o las mujeres. Las consecuencias pueden ir más allá de influir en opiniones. Si las burbujas de niños de barrios populares se centran en comida basura, formación profesional y coches tuneados, pueden desincentivar su búsqueda de nuevos horizontes. No hay ningún dato aún que fundamente si esto ocurre.

La investigación de estos fenómenos en Facebook es difícil. La creación de robots que tengan amigos e interactúen para que el algoritmo detecte su perfil es compleja de programar. El objetivo es reunir suficiente información para analizar las consecuencias: “Si te gusta la comida basura y un día quieres salir de ahí, tu burbuja te seguirá bombardeando con anuncios de hamburguesas. Puede ser que te mantenga en esa burbuja porque hay más dinero en anuncios que en el sector de restaurantes vegetarianos”, dice Cuevas. Las burbujas pueden promover el eco ideológico, pero también la brecha social. Cuevas dice que necesitará al menos 5 años para ver si las consecuencias sociales de la burbuja de Facebook son reales: “En el momento en que se demostrara que tiene implicaciones negativas, van a entrar los reguladores”, dice Cuevas.

El eco hace nuestra vida más cómoda. No tenemos que enfrentarnos -si no queremos- a opiniones discordantes. Las redes exacerban nuestros sesgos en lugar de suavizarlos. La tecnología podría buscar alternativas para ofrecer noticias más plurales, más veraces. Pero hoy no existe un incentivo comercial para crear esas redes.